- Afhalen na 1 uur in een winkel met voorraad

- Gratis thuislevering in België vanaf € 30

- Ruim aanbod met 7 miljoen producten

- Afhalen na 1 uur in een winkel met voorraad

- Gratis thuislevering in België vanaf € 30

- Ruim aanbod met 7 miljoen producten

Zoeken

€ 9,99

+ 9 punten

Uitvoering

Omschrijving

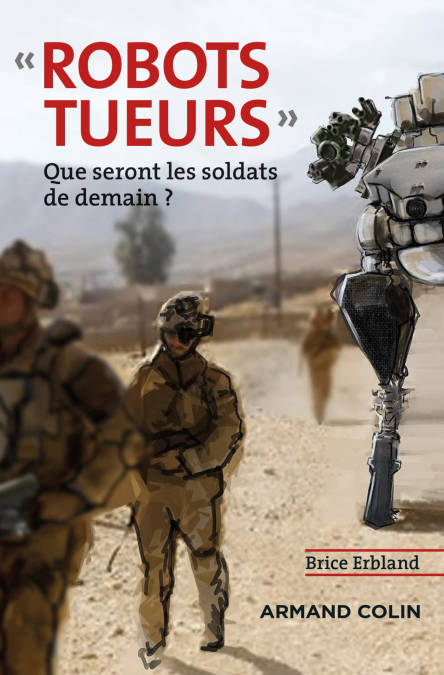

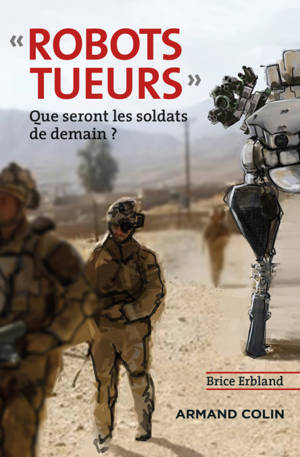

« Robots tueurs », le terme est à la mode mais il fausse d’emblée toute réflexion sur le sujet. Car ce seront des robots soldats qui combattront peut-être dans le futur, non des exterminateurs de la race humaine. Or, qui dit soldat dit faiblesses et vertus au combat. Pour que ces machines soient moralement acceptables, il faut donc qu’elles puissent agir au moins aussi bien qu’un soldat humain, qu’elles puissent « raisonner » d’elles-mêmes sur le plan moral. En d’autres termes, ces robots doivent être dotés d’une éthique artificielle.

Brice Erbland analyse la psychologie humaine au combat afin de mieux proposer ce que pourrait être la programmation d’une éthique artificielle pour les futurs robots de combat. Une approche originale qui n’est ni celle d’un philosophe, ni celle d’un roboticien, mais celle d’un soldat.

Brice Erbland analyse la psychologie humaine au combat afin de mieux proposer ce que pourrait être la programmation d’une éthique artificielle pour les futurs robots de combat. Une approche originale qui n’est ni celle d’un philosophe, ni celle d’un roboticien, mais celle d’un soldat.

Specificaties

Betrokkenen

- Auteur(s):

- Uitgeverij:

Inhoud

- Aantal bladzijden:

- 128

- Taal:

- Frans

Eigenschappen

- Productcode (EAN):

- 9782200621773

- Verschijningsdatum:

- 6/02/2018

- Uitvoering:

- E-book

- Beveiligd met:

- Adobe DRM

- Formaat:

- ePub

Alleen bij Standaard Boekhandel

+ 9 punten op je klantenkaart van Standaard Boekhandel

Beoordelingen

We publiceren alleen reviews die voldoen aan de voorwaarden voor reviews. Bekijk onze voorwaarden voor reviews.